OpenAI gooit beeldsynthese-modellen overhoop

Doordat ChatGPT de afgelopen tijd erg in de belangstelling stond als de tekstrobot die OpenAI baseert op het large Language Model (LLM) GPT, zijn de vorderingen op het gebied van beeldgeneratie wat onderbelicht geraakt. Maar de prestaties van beeldgenererende AI-modellen zoals DALL-E, MidJourney en Stable Diffusion, zijn ook opzienbarend. Niet perfect en er zijn netelige kwesties over auteursrechten, maar het is soms wonderbaarlijk wat deze modellen - ook gebaseerd op LLM's - kunnen.

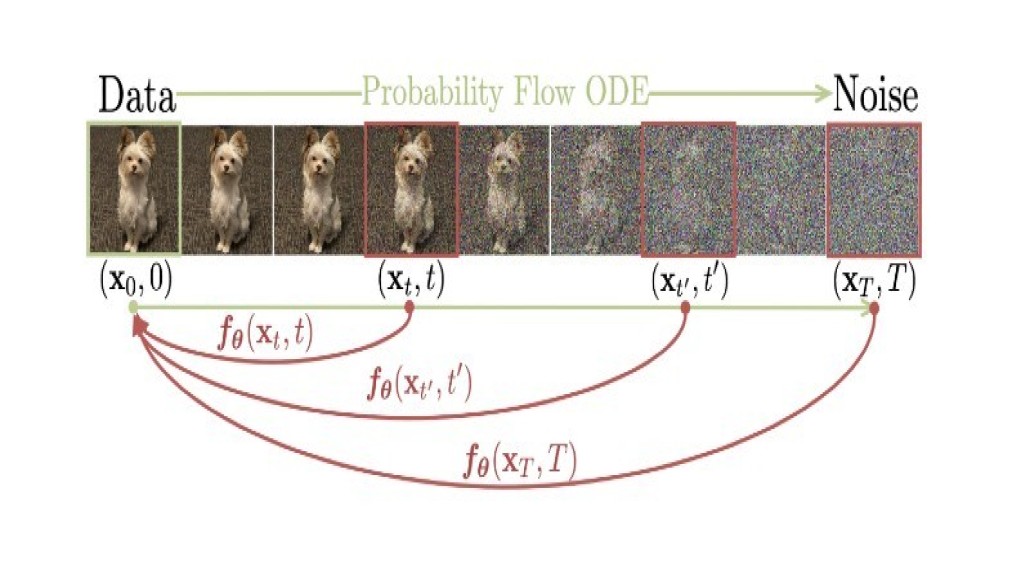

Het resultaat heeft echter wel een prijs in de vorm van computerkracht. Om het model te laten begrijpen wat er op een plaatje te zien is, wordt gebruik gemaakt van de zogeheten diffusion methode. Het plaatje wordt compleet onherkenbaar gemaakt door 'noise' toe te voegen. Vervolgens wordt in een groot aantal iteraties van het leerproces het origineel teruggebracht. Voor een goed resultaat zijn tientallen tot duizenden stappen nodig en dat vergt tijd, rekenkracht en energie.

Die drie zijn de achilleshiel voor de toekomst van veel vormen van kunstmatige intelligentie die nu zo populair zijn. Dus proberen de verantwoordelijke bedrijven niet alleen de kwaliteit te verbeteren, maar zoeken ook naar methoden om het verbruik van energie en rekenkracht te verminderen.

Nieuwe aanpak

OpenAI publiceerde vorige maand een wetenschappelijk artikel met een nieuwe aanpak. In plaats van een diffusion-based model, presenteerde de technici van het bedrijf 'consistency models' die veel effectiever te werk gaan. In plaats van het groot aantal iteraties kunnen deze modellen toe met één stap, hooguit in sommige gevallen aangevuld met een tweede verfijningsstap. Ook deze modellen leren net als de diffusion-modellen, van het langzaam afbreken of herstellen van een afbeelding, maar nemen van elke stap in het proces 'een plaatje' en kunnen hieruit in één keer het origineel opnieuw samenstellen. Elk punt op elk tijdstip in het traject is terug te herleiden naar het beginpunt in het traject. De output is daarom consistent met de beginpunten, een belangrijk gegeven in de methode en daar is de naamgeving van de methode uit afgeleid. Het bovenstaande is een oversimplificatie van de beschreven methode. De juiste uitleg is te vinden in het arxiv-artikel (pdf).

Het resultaat dat de wetenschappers hiermee bereiken is nog lang niet zo goed als bereikt kan worden met de diffusion models. Maar belangrijk is dat het concept blijkt te werken en dus aan de uitgangspunten van minder energieverbruik en een enorme tijdswinst, voldoet.

Het is nu zaak voor OpenAI en andere onderzoekers het concept verder te verbeteren.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee