Google DeepMind maakt herkenning genAI-plaatjes mogelijk

Google DeepMind, de Britse AI-onderzoekstak van het concern, heeft een methode ontwikkeld waarmee afbeeldingen die zijn gemaakt met generatieve AI, kunnen worden opgespoord.

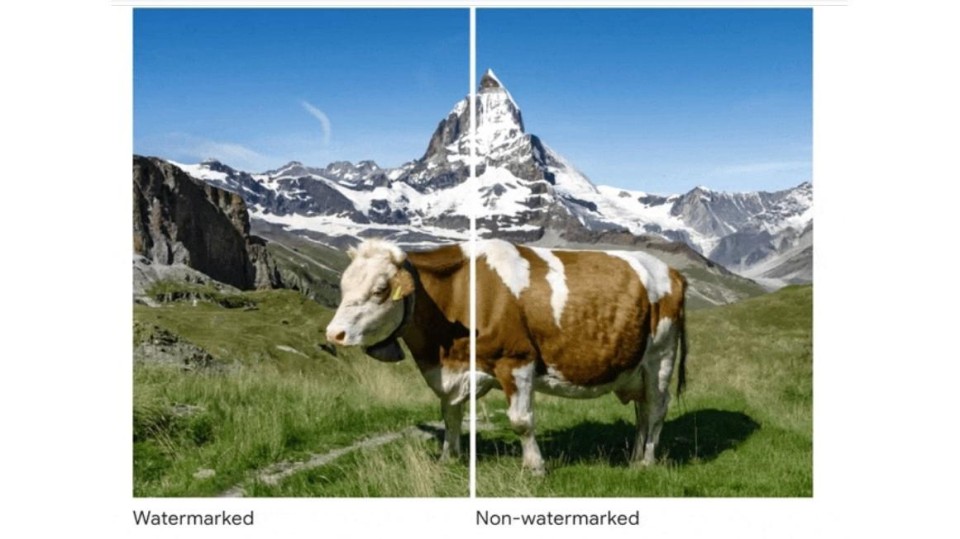

Het bedrijf beschrijft in een blog hoe de onderzoekers zijn gekomen tot de ontwikkeling van SynthID. De technologie is gebaseerd op het toevoegen van een voor de mens onzichtbaar watermerk, dat zelfs na ingrijpende bewerking van de afbeelding nog te detecteren is. SythID brengt het watermerk aan en kan het ook weer opsporen.

Nu in bètaversie beschikbaar

Het gaat nu nog om een bètaversie van de tool en komt als eerste beschikbaar voor een beperkt aantal klanten van Vertex AI, een zakelijk platform om generatieve AI-tools mee te maken. Google voegt bij die klanten SynthID toe aan Imagen, een van de recente toepassingen van Google voor het creëren van afbeeldingen op basis van ingevoerde tekst.

Google DeepMind ziet SynthAI als een bijdrage aan de ontwikkeling van verantwoorde AI. Het wordt voor mensen steeds lastiger een onderscheid te maken tussen door AI gesynthetiseerd beeld en beelden van de werkelijkheid. Die ontwikkeling heeft schaduwkanten omdat mensen met die beelden makkelijk misleid kunnen worden. Door het watermerk toe te voegen aan alle beelden die met AI worden gegenereerd, kan achteraf altijd worden gecontroleerd of het beeld geconstrueerd is of echt.

Derden overtuigen

Voorwaarde voor deze aanpak is wel dat de technologie onderdeel wordt van alle modellen die beelden genereren. Nu is SynthID nog alleen beschikbaar in Imagen, maar Google moet het eerst integreren in alle eigen dienstverlening en bovendien derden ervan zien te overtuigen dezelfde of vergelijkbare technologie te gaan gebruiken. De Google DeepMind-mensen zijn hoopvol dat dit in de nabije toekomst gaat gebeuren.

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonneeAchtergrond info over digitale watermerken (bijvoorbeeld de applicaties hiervan) is te vinden op https://nl.wikipedia.org/wiki/Digitaal_watermerk

Voor degenen met interesse in de wiskundige achtergrond theorie van onzichtbare en onkraakbare watermerken in informatiedragers kunnen bijvoorbeeld "An Information-Theoretic Model for Steganography" op https://citeseerx.ist.psu.edu/document?repid=rep1&type=pdf&doi=b5f364dc21d2cbebe8f4f8f6d3961ff7c4284ee7 lezen.

Informatie-Theoretische bewijzen zijn onconditioneel. Eenmaal bewezen blijven ze voor altijd geldig.

Als je zelf met informatie wilt rekenen (bijvoorbeeld om informatie-theoretische bewijzen te controleren) dan kun je bijvoorbeeld gebruikmaken van het gratis Xitip, zie http://xitip.epfl.ch/