Adaptive Deep Reuse maakt niet alle AI sneller

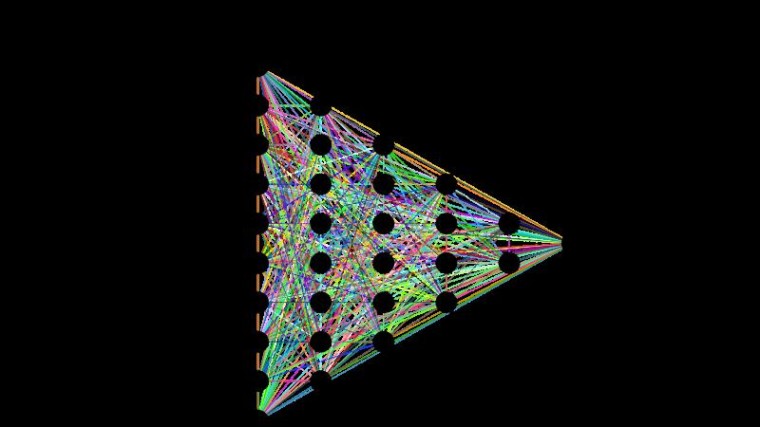

Begin deze week was er in het nieuws dat Amerikaanse onderzoekers een methode hadden bedacht om het de training van een machinelearningsysteem aanzienlijk te versnellen. De trainingsstap duurt doorgaans lang en vereist veel computerkracht. De onderzoekers bedachten een methode die ze Adaptive Deep Reuse noemen, die op een slimme manier kan voorkomen dat repetitieve data die in de trainingssamples voorkomen niet allemaal door het neurale netwerk hoeven te gaan. Zo konden ze op verschillende testneuralenetwerken een tijdsbesparing van meer dan 60 procent bereiken.

Antal van den Bosch, hoogleraar kunstmatige intelligentie aan de Radboud Universiteit en Sander Wubben universitair docent Digital Sciences aan de Universiteit Tilburg zijn het eens in hun commentaar dat de methode die de onderzoekers van de North Carolina State University slechts een van de manieren is om het trainen van neurale netwerken te versnellen. "Maar je moet deze ontwikkeling zien als een hele specifieke optimalisatie van een bepaalde techniek", zegt Van den Bosch.

Hij vergelijkt het met finetunen van een spoiler op een supercar. Maar als je AI ziet als het bouwen van auto's zijn anderen weer bezig met bezig met waterstof-gedreven auto’s, weer anderen met hybride auto’s, weer anderen met klassiekere technieken. "De doelen van de doorontwikkeling zijn dus vaak heel verschillend - trainingssnelheid is niet het enige of belangrijkste is om op te optimaliseren."

Complexer en minder goed uitlegbaar

Van den Bosch noemt nog een reeks andere methoden op om training efficiënter te maken. "Methoden als early stopping, dropout zijn hele standaard heuristieken maar er is ook heel veel gewerkt aan efficiënt gebruik maken van trainingsdata (progressive sampling, active learning, co-training bv. niet alleen met neurale netwerken). De waslijst is eindeloos en de combinatie van methoden is dus nog eindelozer. Het zijn aan de andere kant altijd heuristieken - zonder garantie dat ze altijd werken en het gewenste effect hebben."

Hij verwacht dat in praktijk misschien een of twee mensen uit zijn onderzoeksgroep de methode voorbij zullen zien komen, maar hij betwijfelt of ze hem zullen gebruiken. "Je maakt er je experiment complexer mee en dus minder generiek en moeilijker uitlegbaar."

Sander Wubben sluit zich daar bij aan. "Het is een van de vele optimalisaties waar mensen nu aan werken om bepaalde deep learning technieken efficienter te maken. De vraag is ook hoe je zoiets zou inzetten voor ander soort data."

Reacties

Om een reactie achter te laten is een account vereist.

Inloggen Word abonnee